8. 8. 2017 | Družba

Zakaj na kameri ujet dokaz ni več resničen

Nov računalniški program lahko ustvari lažen videoposnetek kogarkoli, ki govori karkoli. Katerim novicam bomo sploh še lahko verjeli?

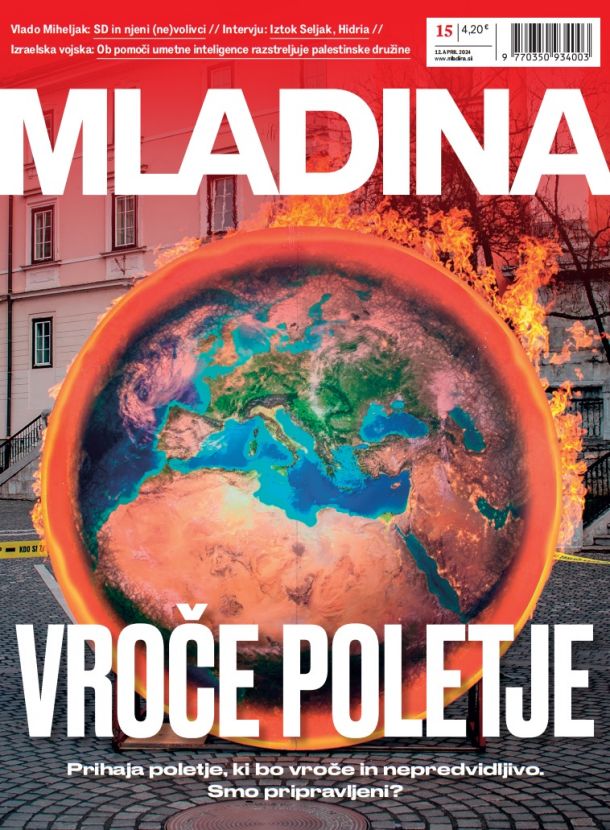

Včasih čarovniki, danes znanstveniki: "Kar vidiš, ni nujno res."

© Flickr

Na realističnem posnetku nekdanjega ameriškega predsednika Baracka Obame, ki kroži po spletu, ni nič posebnega – z izjemo tega, da je video povsem umeten. Posnetek je simulacija računalniškega programa, ki združuje zvočni in video zapis. Medtem ko inovacija odpira nešteto opcij za filmsko industrijo in izboljšanje komunikacijske tehnologije, pa hkrati veča možnosti za lažne novice in medijsko manipulacijo.

Raziskovalci na Washingtonski univerzi (UW) so z razvojem računalniškega programa ustvarili ultra realističen video predsednika Obame, ki nagovarja Američane, poroča The Telegraph. Program omogoča urejanje videoposnetkov ljudi, da izgleda, kot da govorijo nekaj drugega, kot pa v resnici so.

Tako dobrih rezultatov s tovrstno tehnologijo še ni bilo, poudarja Ira Kemelmacher-Shlizerman za UW News, asistentka na Washingtonski univerzi. »Realistična pretvorba zvoka v video ima praktične aplikacije, kot so izboljšanje videokonferenc, pa tudi futuristične, kot na primer sposobnost pogovora z zgodovinsko osebo v virtualni realnosti,« še dodaja.

»Realistična pretvorba zvoka v video ima praktične aplikacije, kot so izboljšanje videokonferenc, pa tudi futuristične, kot na primer sposobnost pogovora z zgodovinsko osebo v virtualni realnosti.«

Program uporablja umetno inteligenco, da prilagaja avdio realističnemu gibanju ust, ki se nato vstavi v nek že obstoječ video posnetek. Manipuliranje gibanja ustnic ni sicer nič novega – že v 2016 so nam raziskovalci s Stanforda predstavili Face2Face, tehnologijo, s katero lahko prenesemo svojo obrazno mimiko na nek subjekt v videu. Razlika v tehnologijah je ta, da se nov program z umetno inteligenco lahko uči iz baze posnetkov, npr. Obame, na spletu. Tako ne gre le za spajanje obstoječih avdio in video posnetkov, ampak se program uči, kakšne oblike ust so povezane z različnimi zvoki. Raziskovalci nato vzamejo nov zvočni posnetek in ga vstavijo v obstoječ video, nato pa vsadijo še značilne oblike ust. Rezultat je strašljivo resničen Obama, ki uprorablja vse prave premike, naklone glave in izraze, po katerih je prepoznaven.

9Yq67CjDqvw

Supasorn Suwajanakorn, vodilni avtor študije, opozarja, da so ljudje še posebej občutljivi na katerekoli dele obraza in ust, ki ne izgledajo realistično. »Če zobje ne izgledajo pravilno ali če se brada premika ob napačnem času, to lahko ljudje takoj opazijo in vse skupaj bo izgledalo lažno.«

V ločeni raziskavi je letos kanadsko podjetje Lyrebird ustvarilo program, ki lahko ponsema skoraj vsak človeški glas. Po le minuti poslušanja lahko program generira tisoče stavkov in zvokov, ki jih ne le posnema, temveč lahko ustvarja tudi nove variacije z realističnimi vsadki intonacije in »čustev«. Tako lahko program ustvari izjemno realistične zvočne posnetke, kot da bi jih izgovarjal npr. Donald Trump, Hillary Clinton ali Obama, poroča The Telegraph.

Primeri kot je ta javnost zmeraj razdvojijo na dva tabora: tiste, ki stremijo k novim možnostim in integraciji novosti v širšo družbo ter tiste, ki v inovaciji vidijo potencialno nevarnost.

Z združevanjem teh novih tehnologij bomo tako kmalu na točki, kjer ne bomo združevali le videa Obame s posnetkom govora iz neke druge situacije, ampak se bodo lahko ustvarjali novi, povsem lažni posnetki z besedami, ki morda sploh nikoli niso prišle iz njegovih ust. Medtem ko raziskovalci predvsem iščejo priložnosti v izboljšanju filmske industrije, komunikacije preko video klicev in celo v pomoči ljudem s težavami sluha, pa se ob razvoju programa predvsem pojavlja vprašanje lažnih novic in manipulacije informacij.

V zgoščeni množici informacij na spletu imamo že tako težave s prepoznavanjem lažnih novic, nova tehnologija pa bi meje med dejstvi in »alternativnimi dejstvi« še bolj zabrisala. A raziskovalna ekipa, ki je avtorica lažnega videa o Obami, želi iti ravno v nasprotno smer. Z razvojem tovrstne tehnologije bi lahko proces obrnili in razvili algoritme, ki bi lahko zaznali, ali je nek posnetek resničen ali manipuliran.

Primeri kot je ta javnost zmeraj razdvojijo na dva tabora: tiste, ki stremijo k novim možnostim in integraciji novosti v širšo družbo ter tiste, ki v inovaciji vidijo potencialno nevarnost. Pravilnih predvidevanj pa na področju tehnologije in znanosti ni, saj so na koncu ljudje tisti, ki novo napravo ali program dobijo v roke. Strah pred tehnološkim napredkom je torej povsem neupravičen, saj je vprašanje le, kaj bomo s to tehnologijo naredili sami.

Pisma bralcev pošljite na naslov pisma@mladina.si. Minimalni pogoj za objavo je podpis z imenom in priimkom ter naslov. Slednji ne bo javno objavljen.