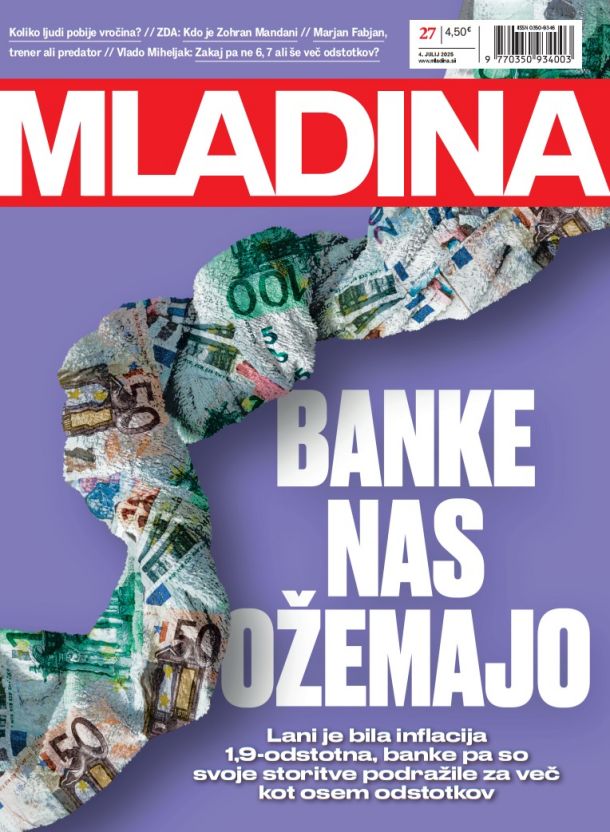

18. 3. 2016 | Mladina 11 | Politika

Algoritmi zla

O računalniških programih, ki se odločajo namesto policistov in sodnikov. Ne na podlagi dokazov, pač pa na podlagi socialno-demografske slike posameznika in okolja, v katerem živi.

Sodniško kladivo, kot simbol tehtanja o posameznikovi usodi. Ga bo nadomestila tipkovnica oziroma sodnikov pritisk na gumb?

© Borut Krajnc

Se spomnite hollywoodske uspešnice Posebno poročilo (Minority report) s Tomom Cruisom v glavni vlogi? Ali pa trilogije Matrica? V prvem filmu o krivdi v kazenskem postopku odločajo jasnovidci, in to vnaprej, preden se zločin sploh zgodi. V trilogiji so stroji, računalniki oziroma računalniški programi na vseh področjih prekosili ljudi. Gre za filme, ki so jih predvajali pred desetletjem in več. Gre za znanstvenofantastične filme, v katerih pa ni nič kaj posebej znanstvenofantastičnega. Računalniški programi, ki predvidevajo, kdaj in kje se bo zgodil zločin, ter programi, ki namesto sodnikov odločajo o priporu in celo o višini kazenske sankcije (in ker gre to z roko v roki, dejansko tudi o krivdi), so se začeli razvijati in uporabljati že pred tem.

Zakup člankov

Celoten članek je na voljo le naročnikom. Če želite zakupiti članek, je cena 4,5 EUR. S tem nakupom si zagotovite tudi enotedenski dostop do vseh ostalih zaklenjenih vsebin. Kako do tedenskega zakupa?

18. 3. 2016 | Mladina 11 | Politika

Sodniško kladivo, kot simbol tehtanja o posameznikovi usodi. Ga bo nadomestila tipkovnica oziroma sodnikov pritisk na gumb?

© Borut Krajnc

Se spomnite hollywoodske uspešnice Posebno poročilo (Minority report) s Tomom Cruisom v glavni vlogi? Ali pa trilogije Matrica? V prvem filmu o krivdi v kazenskem postopku odločajo jasnovidci, in to vnaprej, preden se zločin sploh zgodi. V trilogiji so stroji, računalniki oziroma računalniški programi na vseh področjih prekosili ljudi. Gre za filme, ki so jih predvajali pred desetletjem in več. Gre za znanstvenofantastične filme, v katerih pa ni nič kaj posebej znanstvenofantastičnega. Računalniški programi, ki predvidevajo, kdaj in kje se bo zgodil zločin, ter programi, ki namesto sodnikov odločajo o priporu in celo o višini kazenske sankcije (in ker gre to z roko v roki, dejansko tudi o krivdi), so se začeli razvijati in uporabljati že pred tem.

Računalniški programi se uporabljajo za številne vidike policijskega in sodniškega odločanja. Lahko izračunajo, kolikšna je verjetnost, da bo posameznik pobegnil, če ne bo v priporu, pa kakšna je najprimernejša kazenska sankcija in kakšna najprimernejša višina te sankcije. Vedno več policij preskuša tudi računalniške programe, ki na podlagi podatkov iz preteklosti napovedujejo, kje in kdaj obstaja velika verjetnost, da se bo zgodil zločin. Pri tem so boljši od človeka. Dokazano. Prav se odločijo večkrat kot ljudje. Kakopak statistično gledano. In kakopak so domovina vpeljevanja računalniških programov v odločanje v pravosodju ZDA, kjer pravica že dolgo ni nekaj absolutnega, pač pa stvar pogajanj. In računalniških programov.

Prvi računalniški program, ki je sodnikom »pomagal« določati kazni, je bil uporabljen že leta 1994 v zvezni državi Virginiji, več let preden so nastali omenjeni filmi. Danes v ZDA namesto sodnikov o priporu in pogojnem odpustu iz zapora odločajo računalniški programi že v veliki večini zveznih držav oziroma v vsaj 30 zveznih državah. Vsaj osem zveznih držav pa računalniške programe uporablja za določanje višine kazenske sankcije, ki jo sodnik potem le še izreče. Tak je trend tudi v Kanadi in Veliki Britaniji, ki imata sorodno pravno ureditev. Številne druge države pa z zanimanjem pogledujejo k tem, »naprednim« državam.

In kako računalniški program izračuna, kakšna je pravilna odločitev, kdaj posameznika pripreti, kdaj ne, kakšno in kako visoko kazensko sankcijo naj dobi, kdaj ga izpustiti iz zapora, kdaj ne? Velika večina računalniških programov, ki policiji in sodnikom »pomagajo« pri delu, se odloča na podlagi številnih podatkov, saj jih lahko, logično, obdelajo več, bolje in hitreje kot človek.

Računalniški program na podlagi osebnostnih, socialno-ekonomskih in demografskih značilnosti posameznika izračuna verjetnost, da je oziroma bo ta posameznik kršil zakon.

Ameriški algoritmi

A težava je v tem, na podlagi česa računalniški programi odločajo o usodi posameznika. Večina teh programov odloča na podlagi števila preteklih obsodb, števila zapornih kazni, števila obsodb za nasilno dejanje ali dejanje, povezano z drogami, kar se nekako še zdi smiselno, čeprav gre za odločanje na podlagi preteklosti in ne sedanjosti. A poleg tega ti progami vsebujejo tudi druge spremenljivke, ki odločilno vplivajo na odločitev. Glede na raziskavo, ki jo je opravila profesorica na Univerzi v Michiganu dr. Sonja B. Starr, namreč večina programov vsebuje spremenljivke, kot so spol, starost, stopnja izobrazbe in zaposlitveni status posameznika, torej storilca ali domnevnega storilca kaznivega dejanja. Nemalo pa jih zajame tudi finančni položaj posameznika. Računalniških programov je veliko, vsak pa ima svojo specifiko, predvsem glede na želje pravosodnega sistema, ki ga namerava uporabljati. Zato poleg omenjenih spremenljivk dodajajo tudi druge, še spornejše in še manj povezane s konkretnim kaznivim dejanjem in konkretno osebo oziroma storilcem.

Neki program, uporabljajo ga v Indiani in še sedmih ameriških zveznih državah za odločanje o pogojnih odpustih kaznjencev, o svobodi oziroma nesvobodi posameznika odloča na podlagi prej omenjenih meril in tudi na podlagi pretekle »posameznikove uspešnosti in medčloveških odnosov v službi«, »družinskega oziroma zakonskega statusa«, »stabilnosti njegove nastanitve«, »stopnje kriminala v soseski, kjer živi«, »sodelovanja pri prostočasnih dejavnostih«, »trajanja in narave aktivnosti s prijatelji«, »težav z alkoholom ali drogami«, »čustveno-psihološkega stanja« in tudi glede na »vsesplošno obnašanje«.

Dodatna težava je v tem, še piše Sonja Starr, da ti programi večinoma ne vsebujejo najbolj bistvenega, če ne celo edinega smiselnega oziroma zakonitega merila za odločanje o posamezniku – narave in vrste konkretnega kaznivega dejanja, za katero se sploh izreka zaporna kazen oziroma odreja pripor. Namesto tega ti programi obdelujejo številne podatke, ki z odločanjem o tem, ali je kdo kriv, koliko je begosumen, koliko je možnosti, da bo dejanje ponovil in kako visoko kazen si zasluži, nimajo nič.

Programi niti ne odločajo na podlagi različnih osebnostnih lastnosti konkretnega posameznika, pač pa o tem, kaj se bo zgodilo z njim, odločajo na podlagi statistične verjetnosti na milijone »podobnih« primerov iz preteklosti. Ali gre človek za zapahe ali ne, odločijo na podlagi izračuna, ali so si zapor »zaslužili« ljudje s socialno-demografskimi značilnostmi, ki jim ustreza tudi posameznik, o katerem računalniški program odloča.

»Nasprotujem uporabi demografskih, socialno-ekonomskih in družinskih statusov za določanje, ali bo kdo končal v zaporu in za kako dolgo. Gre za spodbujanje neenakosti pred zakonom in na podlagi tega za diskriminacijo, ki je po mojem neustavna,« pravi Sonja Starr. In dodaja, da gre za odločanje v pravosodnem sistemu na način, zoper katerega je dolga desetletja veljala najosnovnejša prepoved, da je pri odločanju o posamezniku v kazenskem sistemu treba upoštevati okoliščine kaznivega dejanja, ne pa osebnostne lastnosti storilca.

Zagovorniki novega (računalniškega) načina odločanja v pravu sicer trdijo, da to prinaša racionalizacijo oziroma niža stroške pravosodnega sistema, če namesto na desetine zaposlenih številne podatke obdela in ovrednoti en sam računalniški program. In tudi, da je to najprimernejši način za zmanjševanje prezasedenosti zaporov v ZDA, saj lahko sodniki »identificirajo manj nevarne kršilce zakonov« in jih izpustijo na prostost oziroma sploh ne zaprejo. Starrova navkljub letom raziskovanja ni našla dokazov, ki bi podprli utemeljitve zagovornikov. No, morda je edina izjema ugoden vpliv na varčevanje: »Empirične raziskave ne ponujajo nobenih razlogov, da bi verjeli, da vključevanje socialno-demografskih spremenljivk zagotavlja kakršnokoli bistveno izboljšanje glede napovedovanja verjetnosti odklonskega ravnanja posameznika.«

Prizor iz filma Posebno poročilo – »vidka«, ki napoveduje kdaj in kje se bo zgodil zločin in kdo ga bo storil

Slovenski algoritmi

Enega izmed takih računalniških programov razvija tudi skupina računalničarjev s Stanfordove univerze, v kateri sodeluje predavatelj na tej univerzi dr. Jure Leskovec. Program, ki naj bi pomagal sodnikom pri odločanju o odreditvi oziroma neodreditvi in trajanju pripora, je avgusta lani predstavil tudi v Sloveniji, na predavanju z okroglo mizo v organizaciji Inštituta za kriminologijo Pravne fakultete Univerze v Ljubljani. Gre za program, ki kot vsi drugi o posameznikovi usodi »odloča« na podlagi socialno-demografskih podatkov tega posameznika oziroma na podlagi statistične verjetnosti, da bi posameznik s temi socialno-demografskimi lastnostmi moral končati v priporu ali pa ne.

Ali kot je dr. Leskovec pojasnil za MMC RTVSLO: »Program v nasprotju s človeškim sodnikom natančno analizira dva milijona sodnih primerov in najde vzorce v lastnostih prestopnikov, ki so povezani z negativnim obnašanjem v prihodnosti. Analize kažejo, da se človek preveč osredini na osebne karakteristike. Program ima namreč dostop samo do kartoteke osumljenca. Sodnik osebo še vidi in pri presoji uporablja neka dodatna merila, ki ga vodijo v neoptimalne odločitve.« Skratka, kot drugi zagovorniki »računalniškega sojenja« tudi dr. Leskovec to zagovarja z utemeljitvijo, da je večja verjetnost, da do pravilne sodbe pridemo z obdelavo preteklih podobnih primerov kot pa s presojo, ki bi se ozirala po konkretnem posamezniku ter okoliščinah konkretnega primera.

Program dr. Leskovca sicer na splošno ne prinaša nič novega, novo je to, da prihaja v Slovenijo. Izdelek bodo gotovo ponujali na trgu, vsem zainteresiranim državam, policijam oziroma pravosodnim sistemom. A vsaka država, ki bi ga začela uporabljati v svojem pravosodnem sistemu, bi gotovo bila dobrodošla referenca. S tem namenom se je Leskovec med obiskom v Sloveniji ustavil tudi na ministrstvu za pravosodje, kar je potrdil pravosodni minister Goran Klemenčič: »Inovativne informacijske rešitve v sodstvu, skupaj z uporabo kompleksnih analiz velikega števila podatkov, pozdravljam in podpiram. Drži, smo v navezi z dr. Leskovcem, sodelujemo pa tudi z Institutom Jozefa Stefana pri iskanju takih rešitev.«

Računalniški algoritmi so, po ministrovem mnenju, lahko in bodo vse bolj uporabni za »ocenjevanje dejanskega stanja, analiziranje sodne prakse in krepitev njene enotnosti in predvidljivosti«. Veliko priložnosti naj bi po ministrovem mnenju razvoj takšnih rešitev ponujal predvsem pri »nekaterih tipiziranih pravnih in upravnih postopkih, recimo pri izdaji gradbenih dovoljenj, vpisih v zemljiško knjigo ipd.«. Pri tem pa, dodaja Klemenčič, »je treba, vsaj kar se mene tiče, jasno zapisati, da te tehnologije ne podpiram na področju odločanja o krivdi in odgovornosti. To je nekaj imanentno človeškega in je in bo moralo vedno ostati v rokah sodnika ali porote.« Po njegovem bo tudi zaradi napredka tehnologije in sistemov umetne inteligence »pravica« čez desetletje ali dve »gotovo zelo drugačna, kot jo poznamo danes. Tega se ni treba bati, če bomo razumeli, da morajo nekatere stvari vedno ostati v domeni človeškega sodnika in razsodnika.«

Profesor kazenskega prava na ljubljanski pravni fakulteti dr. Matjaž Ambrož pojasnjuje, da je v kazenskem postopku in med izvrševanjem kazenske sankcije več odločitev vezanih na napoved posameznikovega vedenja v prihodnosti, »in te ocene so zelo težavne. Že vreme je težko napovedovati, kaj šele bodoče ravnanje ljudi.« Ambrož se zaveda, da se je v grobem te ocene mogoče lotiti na dva načina. Lahko se zanašamo na posplošitve in statistike, na primerjave s kopico »podobnih primerov«, skratka na tisto, čemur danes pravijo obdelava »velikega podatkovja«. Druga možnost pa je, da se zanesemo predvsem na sodniško vrednotenje individualnega primera. »Nobeden od načinov ni brez nevarnosti in šibkih točk, vendarle pa mislim, da je treba dati prednost oziroma zadnjo besedo drugemu načinu. Zanašanje na statistike je praviloma slepo za posebnosti konkretnega primera, to pa je še posebej moteče, kadar gre za odločanje o človekovi svobodi,« pravi Ambrož. Kot primer navaja poskus »objektiviranja« odmere sankcije oziroma omejevanja polja sodniške proste presoje s t. i. kaznovalnimi smernicami v ZDA. Ta rešitev, ki je napravila iz odmere sankcije precej avtomatizirano in rigidno opravilo, je v številnih primerih pripeljala do tega, da je »izračunana« sankcija delovala neživljenjsko.

Predstojnica katedre za kazensko pravo na ljubljanski Pravni fakulteti dr. Katja Šugman Stubbs pojasnjuje, da se na prvi pogled res zdi, kot da bi računalniški program lahko dejansko odločal, kdaj se odredi pripor in kdaj ne. Ker gre pač za eno izmed najpreprostejših oblik odločanja v pravosodju. A tako je zgolj na prvi pogled. Šugmanova navaja stereotipen primer matere samohranilke s tremi otroki: »Lahko si zamislimo sodnika, ki te mame vseeno ne bo obdržal v priporu, čeprav misli, da je verjetneje kot ne, da bo pobegnila in ne bo prišla na sojenje. Če bi se to res zgodilo, bi računalnik takšno rešitev vodili pod rubriko napačna odločitev.« A Šugmanova se sprašuje, ali bi bila taka odločitev res napačna. Ali je sodnik morda ravnal prav, ko je ženski dal možnost. Nemara pa bi osem od desetih podobnih oseb ne pobegnilo in je prav, da jim je dal možnost. »Pa tudi sicer: ali ni morda vseeno prav, da takšna oseba dobi drugačno obravnavo?«

V ZDA namesto sodnikov o priporu odločajo računalniški programi v večini zveznih držav, v osmih zveznih državah pa že tudi določajo kazensko sankcijo.

Poleg tega računalniški program ne more preverjati »napak«, ki so se zgodile, ker je sodnik v priporu obdržal nekoga, ki bi ga lahko izpustil in bi taka oseba vseeno prišla na sojenje. »Metodološko je zato takšno raziskavo povsem nemogoče korektno zasnovati, česar se je, ko smo podrezali vanj, dr. Leskovec zavedal tudi sam,« opozarja Šugmanova. »Če nekoliko karikiram: vsem napakam bi se lahko izognili samo tako, da bi vse obdolžence obdržali v priporu: računalnik bi bil silovito zadovoljen in bi sodniške odločitve označil za stoodstotno pravilne. Vsi od njih bi se namreč pojavili na sojenju.« In prav v tej paradoksalni situaciji se po mnenju Šugmanove pokaže spornost takšnega programa: s tako odločitvijo bi naredili še veliko več napak, saj bi imeli v priporu številne ljudi, ki bi bili priprti povsem nezakonito, nepošteno in po nepotrebnem. »Za tiste, ki jim te vrednote pomenijo manj, pa se lahko izrazimo v njim bližjih pojmih: ti ljudje bi sicer lahko hodili v službo, plačevali davke, skrbeli za družine in ne bili v breme davkoplačevalcem ...« pravi Šugmanova.

Zakaj računalniški programi ne sodijo v pravosodje? Ker odločajo pravilno in povsem objektivno? Ker odločajo preveč pravilno, preveč objektivno in premalo subjektivno? Sliši se nelogično, skorajda neumno. Pa ni. »Pri kompleksnejših odločitvah, kot je recimo vprašanje krivde ali vrednotenje dokazov, so takšni programi povsem neuporabni, saj mora sodnik opraviti zapleteno vrednostno, moralno in pravno analizo,« pojasnjuje Šugmanova in dodaja, da moramo sprejeti, da ljudje takšne stvari presojamo različno in da ravno zato pravo vsebuje mehanizme, ki to »naravno subjektivnost« nadzirajo: možnost vložitve pritožbe, ki jo presojajo trije sodniki, s čimer se samodejno zmanjša pristranska subjektivnost. »Jasno torej je, da so sodniške odločitve subjektivne, ampak zato tudi bolj človeške. In del tega so tudi napake,« meni Šugmanova. Po njenem ni smiselno, da se na vsak način s popolno transparentnostjo, navidezno matematično objektivnostjo in uravnilovko borimo proti subjektivnosti, h kateri seveda sodijo tudi napake. Morda moramo začeti razlikovati med več vrstami subjektivnosti: »Ene so pogubne za pravo, druge pa so nujne in koristne, čeprav lahko včasih privedejo do napak. V prvo kategorijo sodijo tiste subjektivnosti, ki so povsem nesprejemljive: recimo rasizem, osebno maščevanje, podpora političnih zaveznikov in podobno. V drugo pa gredo tiste, ko nekdo, želeč napraviti pošteno stvar, včasih zagreši tudi povsem človeško napako. Ampak ta vrsta subjektivnosti vsebuje tudi solidarnost, humane odločitve, pravične odločitve, ki pa so včasih navzkriž z matematiko.«

A matematika, algoritmi oziroma računalniški programi, ki formalno policistom in sodnikom pomagajo pri odločanju, dejansko pa odločajo namesto njih, so se zalezli v vse pore odločanja v številnih pravosodnih sistemih. Vsaj v ZDA, ki tudi na tem področju veljajo za zgled. Nič drugače ne bo v Sloveniji, tega se zaveda tudi pravosodni minister Goran Klemenčič. Zato samo nasvet. Sebi in svojim otrokom zagotovite čim višjo stopnjo izobrazbe, čim boljšo službo, pazite, s kom se družite, in predvsem se preselite v čim boljšo sosesko. Sicer bo do vas policija veliko bolj sumničava in pozorna, sodniki pa precej strožji pri odločanju o krivdi, priporu in višini kazni.

Pisma bralcev pošljite na naslov pisma@mladina.si. Minimalni pogoj za objavo je podpis z imenom in priimkom ter naslov. Slednji ne bo javno objavljen.